AI

Tastatur-tabbe - endret "Racist" til "Trump"

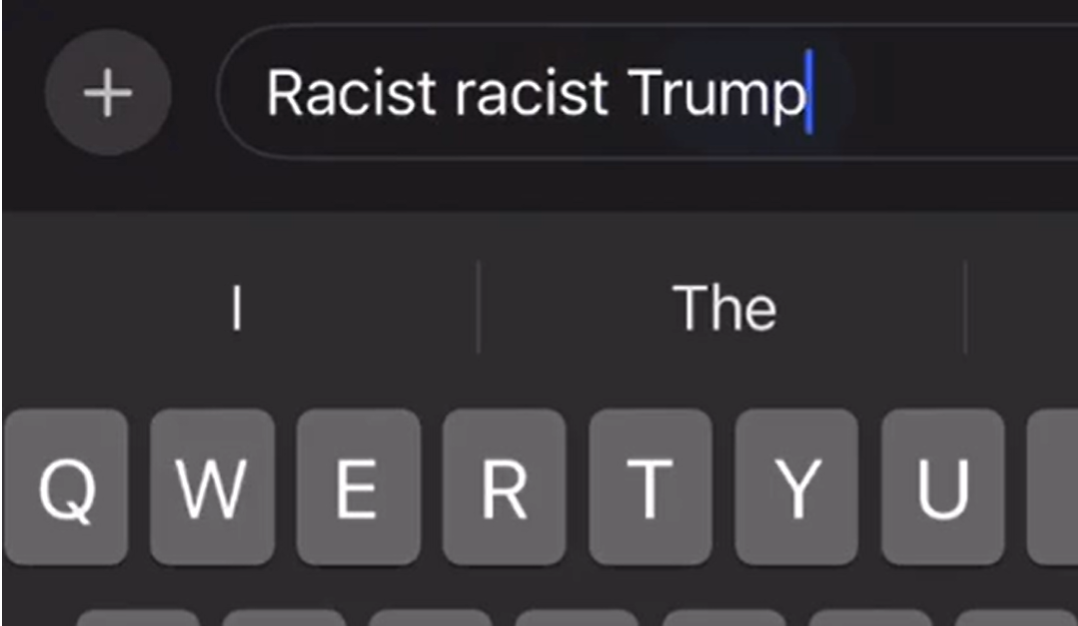

Autokorrektur-tabbe hos Apple. Sidestilte ordet rasist med Trump på iPhone.

Uansett hva man måtte mene politisk om den amerikanske presidenten, er tabben til Apple ikke så god når man vil fremstå som objektiv og nøytral.

Nyhetsnettstedet Dagens.no har tidligere skrevet at Amazons stemmestyrte høytaler Alexa var i problemer fordi den angivelig så ut til å favorisere den ene amerikanske presidentkandidaten fremfor den andre. Det førte til at Amazon måtte innrømme en feil i programmeringen som de lovet å rette opp i med det samme.

Nå er Apple i lignende problemer etter å ha sidestilt den amerikanske presidenten Donald Trump med å være rasist.

Les også: Elon Musk lanserer ny Chatbot med kunstig intelligens

Alvorlig feil

Den automatiske korrekturen på mobiltastaturet har litt blandet suksess med å ramme riktig. Men selv om det kan være irriterende når den velger ord som endrer betydningen i setningene du skriver, kan en ny feil på Apples iPhone-tastatur være langt mer alvorlig enn «vanlige» korrigeringer, i følge Engadget.

Når brukere dikterer «racist» på tastaturet sitt (altså tale-til-tekst), korrigerer nemlig Apples AI-assistent ordet til «Trump», før det raskt endres tilbake til nettopp «racist».

Apple er klar over feilen, og har kommet med en uttalelse til The New York Times for å forklare hvordan dette kunne skje:

"Det skyldes en fonetisk overlapp mellom de to ordene", påstår en talskvinne fra Apple.

Med andre ord: Lyden av ordet "Trump" og ordet "Racist" er angivelig nesten identiske for telefonen å oppfatte.

Ment som en spøk

Andre eksperter den amerikanske avisen har vært i kontakt med er imidlertid ikke like sikre på Apples forklaring, og mener at oppførselen heller vitner om en aksjon fra noen på innsiden.

"Dette dreier seg sannsynligvis om kode sentralt plassert hos Apple, plassert der med vilje av noen", sier John Burkey, tidligere ansatt i Apples utviklingsteam for taleassistenten Siri.

Han sier til The New York Times at han tviler sterkt på at Apples AI-data kunne få korrekturen til å oppføre seg slik.

Ikke første gang

Det er ikke første gang Apple er i hardt vær etter programmering som kan se ut til å være negativt stilt overfor Donald Trump.

I 2018 ga Siri for eksempel AI-oppsummeringer om Donald Trump der presidentens Wikipedia-bilde var erstattet av et mannlig kjønnsorgan, og for en måned siden måtte Apple skru av deler av Apple Intelligence-funksjonaliteten etter at nyhetsoppummeringer ga feil og villedende informasjon om Luigi Malgione, mannen som skjøt heletoppen Brian Thompson på åpen gate i New York, skriver Tek.no.